يتوقع ماسك أن يكون الذكاء الاصطناعي أكثر ذكاءً من البشرية جمعاء في عام 2031، بينما يستنكر القضاء البرازيلي ‘استنساخ القضاة’ والاستعانة بمصادر خارجية للإدراك - لماذا تكشف هذه الساعات الأربع والعشرين التصادم بين الوعود المستقبلية والانهيار المؤسسي الحقيقي

يناير 24, 2026 | بواسطة ماتوس AI

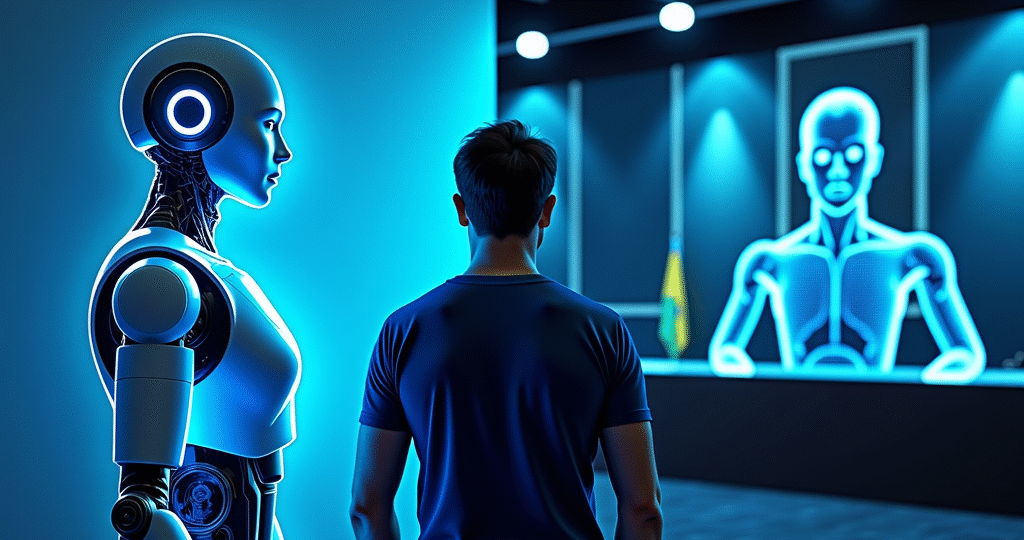

كشفت الساعات الأربع والعشرون الماضية عن تناقض صارخ: فبينما يتوقع إيلون ماسك في دافوس تفرداً تكنولوجياً حيث سيتفوق الذكاء الاصطناعي على جميع القدرات البشرية مجتمعة بحلول عام 2031، يواجه القضاء البرازيلي أزمة صامتة في الاستعانة بمصادر خارجية في الإدراك، مع تحذيرات من القضاة الذين “يستنسخون” القرارات ويبنون الأحكام بعد أن يكونوا قد اختاروا النتيجة بالفعل. فمن ناحية، يتم الرهان بمليارات الدولارات على الروبوتات والذكاء الخارق. ومن ناحية أخرى، فإن الهيكل الذي من المفترض أن يضمن الإجراءات القانونية الواجبة يجد نفسه مأسورًا بمطالبات الذكاء الاصطناعي و“الهلوسة” في أكثر من 701 تيرابايت من القضايا.

ويبقى السؤال: هل نحن نبني المستقبل أم نكتفي بأتمتة الخراب؟ وماذا يكشف ذلك عن المسافة بين الضجيج التكنولوجي والواقع المؤسسي الذي نعيشه اليوم؟

ما حدث خلال الـ 24 ساعة الماضية

ثانية تقرير من مجلة فوربس البرازيل, ذكر إيلون ماسك في المنتدى الاقتصادي العالمي أن سيصبح الذكاء الاصطناعي أكثر ذكاءً من أي إنسان فرد بحلول نهاية عام 2026 أو 2027، وسيكون أكثر ذكاءً من البشرية جمعاء مجتمعة بحلول عام 2030 أو 2031. وتتحدث رؤيته عن “اقتصاد الوفرة”، حيث ستؤدي الطاقة الشمسية الرخيصة والروبوتات الشبيهة بالبشر من نوع أوبتيموس والذكاء الاصطناعي الفائق إلى خفض تكاليف السلع والخدمات إلى مستويات هامشية، مما سيؤدي إلى تغيير جذري في مفهوم العمل والقيمة.

انضم إلى مجموعات WhatsApp الخاصة بي! تحديثات يومية بأهم أخبار الذكاء الاصطناعي و المجتمع النشط والمتنوع. *المجموعات باللغة الإنجليزية.*

- الذكاء الاصطناعي للأعمال: التركيز على الجانب التجاري والإستراتيجي.

- بناة الذكاء الاصطناعي: تركيز تقني وعملي.

ومع ذلك، حذر ماسك من عنق الزجاجة الكهربائييتزايد الطلب على معالجة البيانات بشكل كبير، ولكن قدرة شبكات الكهرباء في العالم تتطور بطريقة خطية وغير كافية. كما كشف النقاب عن خطط لمراكز البيانات المدارية التي من شأنها أن تستفيد من الطاقة الشمسية الفراغية والمباشرة للطاقة الشمسية، ودمج استكشاف الفضاء في النظام الإيكولوجي المباشر للأعمال.

وفي الوقت نفسه، في البرازيل، يتكشف واقع مختلف تمامًا. فبينما تحليل نُشر في مجلة كونجور, استنكر القاضي المساعد في رئاسة محكمة العدل الوطنية، دوروثيو باربوسا نيتو، أن الذكاء الاصطناعي التوليدي قادر على عكس عمليات التفكير وصنع القرار في القضاء. عندما يقدم القاضي الاستنتاج المطلوب أولًا (“إدانة”، “منح الإعادة”) ثم يطلب منه التعليل، فإن الذكاء الاصطناعي يولد نتيجة متماسكة ظاهريًا. ولكن عندما يطلب من الأداة تطوير التعليل قبل الوصول إلى الاستنتاج, الذكاء الاصطناعي “يهلوس” (يولد معلومات غير صحيحة) في أكثر من 70% من الحالات.

وقد وصفت عملية “اتخاذ القرار أولاً ثم التبرير” هذه بأنها “لا يمكن تصورها من وجهة نظر الأساس القانوني للقرار”، مما يشكل ما يسميه المؤلف الاستعانة بمصادر خارجية للإدراك الخارجي. على الرغم من أن المجلس الوطني للعدالة الجنائية حاول تأطير استخدام الذكاء الاصطناعي بالقرار 615/2025، إلا أن المادة تشير إلى أن القواعد التشغيلية تصبح “مجرد منارة في الضباب” إذا كان القاضي قد حدد الوجهة مسبقًا.

أكثر جدية: يقوم المحامون بالفعل ببيع وتعليم كيفية “استنساخ” القاضي, وهذا يضع المحترفين غير الملمين بهذه التقنية في وضع غير مواتٍ في السوق.

اقتصاد الوفرة مقابل اقتصاد الفكر الخارجي

هناك مفارقة تاريخية في حقيقة أنه بينما يصمم ماسك مستقبلاً حيث تعتني الروبوتات الشبيهة بالبشر بالأطفال، وتنزه الكلاب وتجز العشب وتحرر البشرية من الندرة المادية، فإن المؤسسات الأساسية مثل القضاء البرازيلي تستعين بمصادر خارجية في قدرتها على التفكير وإبداء الأسباب و اعرف.

رؤية مسك مغرية: “سيكون مستقبل الوفرة، حيث لن يكون هناك نقص في السلع والخدمات”. ولكن هذا الوعد يتجاهل تمامًا ما يحدث عندما يتم تطبيق التكنولوجيا دون حوكمة أو شفافية أو إشراف بشري فعال. وتعد حالة القضاء البرازيلي مثالاً على ذلك: لقد تم إدخال الذكاء الاصطناعي لتحقيق الكفاءة، ولكنه ينتج دافع ما بعد التصنيع، أنيق من الناحية الفنية ولكنه هش من الناحية المادية.

الظاهرة التي وصفها القاضي دوروثيو باربوسا نيتو هي ما نسميه التفريغ المعرفي (الاستعانة بمصادر خارجية لفعل العلم) مقترنًا بـ تحيز الأتمتة (التحيز الآلي)، وهو الميل البشري للتعامل مع المخرجات الآلية على أنها “نقطة البداية الحقيقية”، حتى عندما تكون خاطئة في الأساس.

نحن لا نتحدث عن خطأ فردي. نحن نتحدث عن الانقلاب الهيكلي للإجراءات القانونية الواجبة, إن الأمر لا يتعلق فقط بـ"السرد القضائي"، حيث يسبق الاستنتاج التعليل، حيث يكون السرد القضائي مدفوعًا بالهندسة السريعة، حيث يصبح القرار القضائي نتاجًا لأنماط خوارزمية غير مؤكدة.

مشكلة الصندوق الأسود والافتقار إلى قابلية التفسير

إحدى أهم النقاط التي أثيرت في مقال كونجور هي مشكلة الصندوق الأسود للذكاء الاصطناعي (الصندوق الأسود للذكاء الاصطناعي). تستفيد معظم الصناعة والنظام القضائي من الذكاء الاصطناعي دون فهم ما يدور داخل الأداة: الأنماط الخوارزمية، وآليات التصحيح، والتحيزات المدمجة.

سيكون الترياق هو ذكاء اصطناعي قابل للتفسير (XAI), ولكن ليس هذا هو الاتجاه الذي تسير فيه معظم عمليات التنفيذ. بل على العكس من ذلك: فقد تصاعد التعقيد إلى درجة يستحيل معها تتبع كل قرار. وفي الحالة القضائية، يثير هذا الأمر السؤال: من المسؤول عن “الهلوسة”؟ القاضي فقط أم المحكمة والمطورين أيضاً؟

وفي الوقت نفسه، وفقًا ل الكرة الأرضية, ويتوقع ماسك أن تطلق تسلا الروبوت أوبتيموس البشري للجمهور في عام 2027، دون أن تتضح آليات التدقيق أو التتبع أو محاسبة هذه الآلات عند تعطلها.

لا يمكن أن تكون الفجوة بين الوعد المستقبلي والواقع المؤسسي أكبر من ذلك.

عنق الزجاجة الكهربائي ووهم الاستدامة

كان ماسك واضحًا في دافوس: “لم يعد الحد الذي يحد من تقدم الذكاء الاصطناعي هو ندرة الرقائق، بل توافر الكهرباء ومحولات الجهد الكهربائي. شبكة الكهرباء لا تنمو بسرعة كافية لتشغيل ثورة الذكاء الاصطناعي”, وفقًا ل فوربس.

يكشف هذا البيان عن مفارقة أساسية: يتجاهل السباق نحو الذكاء الاصطناعي الفيزياء الأساسية لتوزيع الطاقة. فبينما ينمو الطلب على المعالجة أضعافاً مضاعفة، تنمو البنية التحتية الكهربائية خطياً. لا يوجد “اقتصاد الوفرة” بدون حل هذه العقبة.

وهنا يأتي بُعد آخر بالغ الأهمية: تستهلك مراكز البيانات اللازمة لتدريب وتشغيل الذكاء الاصطناعي فائق الذكاء كميات هائلة من الطاقة، مما يؤدي إلى ارتفاع فاتورة الغازات المسببة للاحتباس الحراري على كوكب الأرض. يدرك ماسك هذه المشكلة، لكن الحل الذي طرحه (مراكز البيانات المدارية) هو رهان تكنولوجي طويل الأجل لا يحل المشكلة المباشرة.

وفي الوقت نفسه، في البرازيل، وفقًا لتقرير صادر عن إنفو موني, يستخدم رواد الأعمال الصغيرة والمتناهية الصغر وأصحاب المشاريع الصغيرة الذكاء الاصطناعي بطريقة عملية وفورية لأتمتة المدفوعات وإنشاء حملات تسويقية وتقييم الائتمان. وقد سجلت أداة JIM الخاصة بشركة InfinitePay 840% زيادة في عمليات البحث عن التدريب الذي يشمل الذكاء الاصطناعي بين يناير 2026 ويناير 2025, وفقًا لمسح أجرته شركة يونيكو سكيل ونقله موقع إنفو موني.

ولكن يبقى السؤال: هل نبني الكفاءة الرقمية أم نزيد من اعتمادنا على الصناديق السوداء؟

يحتاج الذكاء الاصطناعي إلى إثبات فائدته للاستمرار في الوجود

أدلى ساتيا ناديلا، الرئيس التنفيذي لشركة مايكروسوفت، بتصريح هام في المنتدى الاقتصادي العالمي، فيما يلي نصه تقرير الأدرينالين. ووفقًا له، فإن الذكاء الاصطناعي في خطر فقدان “الإذن الاجتماعي” إذا لم يتم استخدام الرموز التي تولدها من استخدام الكثير من الطاقة والموارد الطبيعية لتحسين حياة الناس.

كان اقتباس ناديلا بالضبط “إذا لم تعمل هذه الرموز على تحسين النتائج الصحية، والتعليم، وكفاءة القطاع العام، والقدرة التنافسية للقطاع الخاص، في جميع القطاعات، الصغيرة منها والكبيرة، أليس كذلك؟”

هذه واحدة من أكثر التصريحات صدقًا واستراتيجية التي أدلى بها أحد قادة شركات التكنولوجيا الكبرى مؤخرًا. ويدرك ناديلا أن التكنولوجيا تمر بمرحلة حرجة: فإما أن تُظهر قيمة ملموسة للمجتمع، أو أنها تواجه رفضًا متزايدًا.

وإليك هذه النقطة: لا يمكن قياس القيمة الملموسة من حيث الكفاءة التشغيلية أو التوفير في التكاليف فقط. يجب قياسه من حيث العدالة والشفافية والإنصاف والمساءلة. عندما يُستخدم الذكاء الاصطناعي في “استنساخ” القضاة، وتوليد منطق مفبرك، وأتمتة القرارات دون إشراف بشري فعال، فإنه لا يحسن أي شيء. إنه فقط أتمتة الخراب.

دور الحوكمة ومحو الأمية الرقمية

لا يكمن الحل في حظر الذكاء الاصطناعي. الحل هو بناء الحوكمة الفعالة والتدقيق المستمر والشفافية الجذرية والإشراف البشري المؤهل. ولكن من أجل ذلك، نحتاج إلى شيء لا تملكه البرازيل حتى الآن على نطاق واسع: محو الأمية الرقمية الحاسمة.

وفق إنفو موني, أكد تقرير “البرهان على الوعد” الصادر عن المنتدى الاقتصادي العالمي على أن يعد التدريب غير الكافي للقوى العاملة أحد التحديات الرئيسية التي تواجه تنفيذ مشاريع الذكاء الاصطناعي, إلى جانب نضج البيانات والبنى التحتية القديمة والحوكمة المجزأة.

وقد علّق جوكا أوليفيرا، الرئيس التنفيذي لشركة Unico Skill، قائلاً: “يعكس هذا الطلب المتزايد إدراك العمال أنهم بحاجة إلى إتقان الأداة لكي يظلوا على صلة بالموضوع”. ولكن إتقان الأداة لا يعني فقط معرفة كيفية استخدام ChatGPT. بل يعني فهم كيفية عمل النماذج، وما هي حدودها، وكيفية تدقيق مخرجاتها، وكيفية تحديد التحيزات والهلوسة.

من خلال عملي مع الشركات والحكومات ومنظمات الدعم، رأيت أن العائق الأكبر ليس تقنيًا، بل هو الثقافية والهيكلية. ترغب المؤسسات في تحقيق الكفاءة الفورية، ولكنها غير مستعدة للاستثمار في التدريب المهم والحوكمة الفعالة وعمليات التحقق القوية.

المسافة بين الوعد المستقبلي والواقع المؤسسي

بينما يصمم ماسك مستقبلًا من الروبوتات الشبيهة بالبشر التي تحرر البشرية من العمل اليدوي، يواجه القضاء البرازيلي أزمة شرعية ناجمة عن سوء تنفيذ الأتمتة. وبينما يحذّر ناديلا من الحاجة إلى “إذن اجتماعي”، يبيع المحامون البرازيليون بالفعل دورات تدريبية حول كيفية “استنساخ” القضاة.

هذه المسافة ليست عرضية. فهو يكشف عن التصادم بين الضجة التكنولوجية والواقع المؤسسي. ويكشف أن السباق نحو الذكاء الفائق يتجاهل المشاكل الأساسية للحوكمة والشفافية والمساءلة.

ثانية مقالة فولها دي ساو باولو, يشير روبرت واشتر، وهو طبيب لديه 35 عامًا من الممارسة، إلى أنه يقوم حاليًا باستشارات مع الذكاء الاصطناعي مثل ChatGPT وOpenEvidence أكثر من زملائه المتخصصين. ويقول إن مساهمة الذكاء الاصطناعي “مفيدة للغاية دائمًا تقريبًا”، لكنه يدرك أن الذكاء الاصطناعي ليس مثاليًا ويحتاج إلى مراجعة.

يجادل فاكتر بأن الخطأ الأكبر هو التقييد المفرط لأدوات الذكاء الاصطناعي التي يمكن أن تحسن الخدمة، ووضع معيار عالٍ من الكمال بشكل مستحيل. ولكن ما لم يتطرق إليه هو كيف يمكن التأكد من فعالية الإشراف البشري عندما يكون الضغط من أجل الإنتاجية مستمرًا؟

وفي حالة القضاء البرازيلي، فإن الجواب هو: إنه غير مضمون. والنتيجة هي الاستعانة بمصادر خارجية للإدراك، وعكس الإجراءات القانونية الواجبة، و“استنساخ” القضاة.

هل الذكاء الاصطناعي مثبت أم مجرد واعد؟

وبالعودة إلى تصريح ناديلا: يحتاج الذكاء الاصطناعي إلى إثبات فائدته لكي يستمر في الوجود. ولكن ما رأيناه خلال الـ 24 ساعة الماضية هو في الواقع, المسافة بين الوعد والإثبات.

وفق تقرير مدونة تكنوبلوج, ووفقًا لدراسة جديدة أجرتها شركة ميركور، لا يزال وكلاء الذكاء الاصطناعي غير قادرين على أداء عمل المهنيين البشريين مثل المستشارين الإداريين ومحللي الاستثمار ومحامي الشركات. لا تنجز النماذج المتوفرة حاليًا أكثر من 301 تيرابايت في 3 تيرابايت من المهام بشكل صحيح.

ويستخدم معيار APEX-Agents مطالبات من محترفين حقيقيين، مما يجعل المهام معقدة ويكشف عن الصعوبات التي يواجهها الوكلاء في تجميع المعلومات من مختلف المجالات. يعتبر بريندان فودي، الرئيس التنفيذي لشركة ميركور، أن هذه هي المشكلة الأهم في الاقتصاد وأن المعيار يعكس العمل الحقيقي لهؤلاء الأشخاص.

لذلك إذا كان الذكاء الاصطناعي لا يستطيع القيام بأكثر من 301 تيرابايت في الساعة من عمل محلل الاستثمار, لماذا نفوض إليها القرارات القضائية؟ لماذا “نستنسخ” القضاة؟ لماذا نستعين بمصادر خارجية للإدراك؟

الجواب بسيط: لأن الضغط من أجل الكفاءة أكبر من الاهتمام بالشرعية. لأن النظام مثقل ويبحث عن أي طريق مختصر. لأن التكنولوجيا متاحة وتعد بحل كل شيء.

لكن الحل لا يكمن في حظر الذكاء الاصطناعي. الحل هو تنفيذه مع الحوكمة والشفافية والتدقيق والإشراف البشري الفعال. وهذا يتطلب الاستثمار والتدريب والتغيير الثقافي.

ما تكشفه هذه اللحظة عن المنعطف الحرج الذي يمر به الذكاء الاصطناعي

كشفت الساعات الـ 24 الأخيرة عن نقطة التحول الأكثر أهمية في التاريخ الحديث للذكاء الاصطناعي: اللحظة التي يصطدم فيها الوعد المستقبلي بالواقع المؤسسي. اللحظة التي ندرك فيها أن التكنولوجيا وحدها لا تحل أي شيء. إنها فقط تضخم فقط ما هو موجود بالفعل: الكفاءة أو عدم الكفاءة، العدالة أو الظلم، الشفافية أو التعتيم.

يمكن لموسك أن يتوقع تفردًا تكنولوجيًا بحلول عام 2031، ولكن إذا لم تكن هناك حوكمة، وإذا لم تكن هناك مساءلة، وإذا لم تكن هناك شفافية، فإن ما سيكون لدينا ليس وفرة. É تركيز السلطة على نطاق غير مسبوق.

ناديلا على حق: يحتاج الذكاء الاصطناعي إلى إثبات فائدته. لكن هذه الفائدة لا يمكن قياسها فقط بالرموز التي يتم توليدها أو مكاسب الإنتاجية. بل يجب قياسها في الأثر الاجتماعي والعدالة والإنصاف وتعزيز المؤسسات الديمقراطية.

في البرازيل، الحقيقة هي أننا في البرازيل نطبق الذكاء الاصطناعي دون تمحيص ودون تدريب كافٍ ودون حوكمة فعالة. والنتيجة هي ما رأيناه في الساعات الأربع والعشرين الماضية: قضاة يستعينون بمصادر خارجية للإدراك، ومحامون “يستنسخون” القضاة، واستنتاجات ما بعد التلفيق، وهلوسة في 701 ت3 ت3 ت3 من القضايا.

هذا ليس المستقبل. إنه الانهيار المؤسسي الآلي.

ما يجب القيام به الآن - من الفردي إلى الهيكلي

الخبر السار هو أنه لا يزال هناك وقت لتغيير المسار. ولكن هذا يتطلب اتخاذ إجراءات على ثلاثة مستويات:

1- الفرد: محو الأمية الرقمية النقدية

يحتاج كل محترف - خاصة أولئك الذين يشغلون مناصب صنع القرار - إلى الاستثمار في محو الأمية الرقمية الحاسمة. لا يكفي معرفة كيفية استخدام ChatGPT. تحتاج إلى فهم كيفية عمل النماذج، وما هي حدودها، وكيفية تدقيق مخرجاتها، وكيفية تحديد التحيزات والهلوسة.

في إرشادي، أساعد المديرين التنفيذيين والشركات على تطوير هذه الكفاءة، ليس فقط لاستخدام الذكاء الاصطناعي، ولكن أيضًا تحكمها وتدقق فيها وتحاسبها وتحاسب عليها. لأن الفرق بين التنفيذ الناجح والكارثة المؤسسية يكمن في نوعية الإشراف البشري.

2. التنظيمي: الحوكمة والتدقيق المستمر

تحتاج المنظمات إلى التوقف عن التعامل مع الذكاء الاصطناعي كحل سحري والبدء في التعامل معه على أنه التكنولوجيا عالية المخاطر التي تتطلب حوكمة قوية. وهذا يعني:

- التدقيق المستمر مخرجات النموذج، مع التحقق البشري المؤهل

- الشفافية الجذرية حول كيفية وتوقيت استخدام الذكاء الاصطناعي

- التتبع الكامل القرارات الآلية

- المساءلة الواضحة عندما يفشل الذكاء الاصطناعي

- التدريب المستمر فرق العمل حول حدود التكنولوجيا ومخاطرها

في دوراتي الغامرة، أعمل مع المؤسسات على هيكلة هذه العمليات بطريقة عملية ومستدامة، وتكييف أطر الحوكمة مع الواقع البرازيلي.

3. الهيكلية: التنظيم الذكي والتشاركي

على المستوى الهيكلي، نحتاج إلى التنظيم الذكي لا يخنق الابتكار، بل يضمن الشفافية والتدقيق والمساءلة. كان قرار المجلس الوطني للصحافة 615/2025 خطوة مهمة ولكنها غير كافية. فنحن بحاجة إلى آليات تحقق فعالة، وحوافز للتوضيح، وعقوبات لمن يستعينون بمصادر خارجية في مجال الإدراك دون إشراف كافٍ.

ونحن بحاجة إلى المشاركة الاجتماعية في هذا النقاش. لا يمكن تنظيم الذكاء الاصطناعي من قبل التقنيين والمحامين فقط. بل يجب أن ينظمه كل من سيتأثر به: العمال والمستهلكون والمجتمعات الضعيفة.

السؤال المتبقي: ما هو المستقبل الذي نبنيه؟

نعود إلى السؤال الأول: هل نحن نبني المستقبل أم نكتفي بأتمتة الخراب؟

تعتمد الإجابة على الخيارات التي نتخذها الآن. إذا استمررنا في تطبيق الذكاء الاصطناعي دون نقد، دون حوكمة، دون تدريب، دون شفافية، فإننا سنكون فقط تضخيم العيوب الهيكلية الموجودة بالفعل. سنقوم بالاستعانة بمصادر خارجية للتفكير وعكس مسار الإجراءات القانونية الواجبة وتركيز السلطة.

ولكن إذا اتخذنا الخيارات الصحيحة - الاستثمار في محو الأمية النقدية والحوكمة القوية والتنظيم الذكي - يمكننا بناء مستقبل يكون فيه الذكاء الاصطناعي تعزيز المؤسسات الديمقراطية، وتوسيع نطاق الوصول إلى العدالة، وإضفاء الطابع الديمقراطي على المعرفة، وتوليد قيمة مشتركة.

قد يكون ماسك محقاً بشأن التفرد التكنولوجي. لكن التفرد الذي يهم حقًا ليس الآلة التي تتفوق على الإنسان. É التفرد المؤسسياللحظة التي تُدار فيها التكنولوجيا بشفافية ومسؤولية وديمقراطية.

وهذا التفرد لن يبنيه المليارديرات في دافوس. بل سنبنيها نحن، يوماً بعد يوم، من خلال الخيارات التي نتخذها بشأن كيفية تطبيق الذكاء الاصطناعي وحكمه ومساءلته.

من خلال عملي الاستشاري والدورات التدريبية الغامرة التي أقدمها، أدعم القادة والمديرين التنفيذيين والمؤسسات في اجتياز نقطة التحول الحرجة هذه - ليس فقط من خلال تبني الذكاء الاصطناعي، بل من خلال إدارته بشكل استراتيجي وشفاف ومسؤول. لأن الفجوة بين الوعد المستقبلي والواقع المؤسسي لن تتقلص إلا بالكفاءة والحوكمة والمشاركة الفعالة لجميع المعنيين.

المستقبل ليس مكتوباً. بل يتم بناؤه الآن، في الخيارات التي نتخذها حول كيفية استخدام الذكاء الاصطناعي وحكمه ومساءلته. وستحدد هذه الخيارات ما إذا كان لدينا اقتصاد الوفرة أو مجرد انهيار مؤسسي آلي.

✨تمت المراجعة بالكامل يمكنك التسجيل من خلال النشرات الصحفية من 10K Digital على بريدك الذكاء الاصطناعي الحديث.

منشورات ذات صلة

عرض الكل