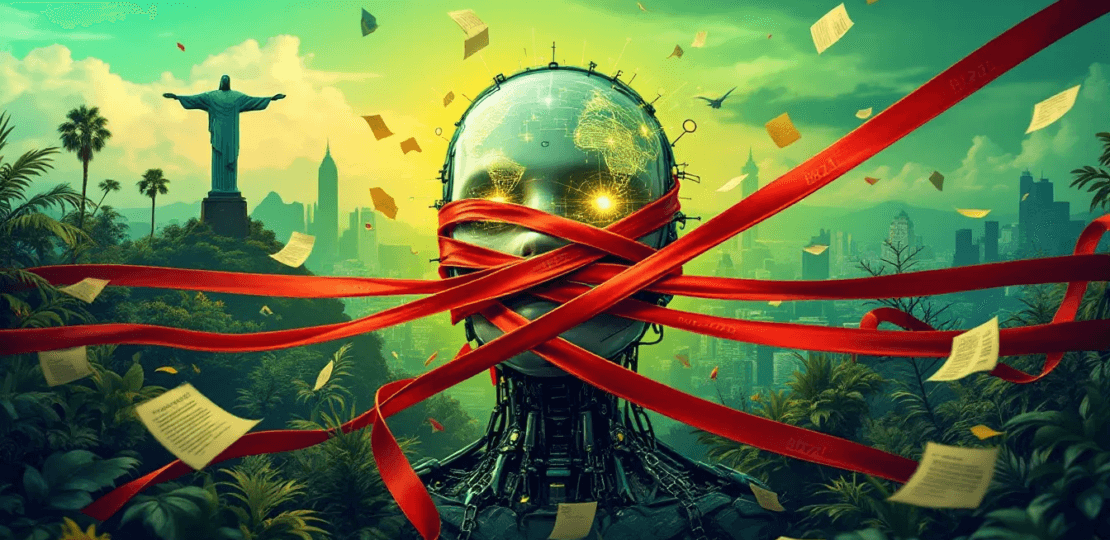

لماذا قد يؤدي تنظيم الذكاء الاصطناعي إلى تدمير الشركات الناشئة في البرازيل؟

6 يناير 2024 | بقلم فيليبي ماتوس

اكتسبت تنظيمات الذكاء الاصطناعي أهمية عالمية، حيث تسعى البلدان إلى وضع إرشادات واضحة لتطوير هذه التكنولوجيا وتطبيقها. وفي البرازيل، يتقدم هذا النقاش مع معالجة مشروع القانون رقم 21/2020 في مجلس الشيوخ الاتحادي. باعتباري رائد أعمال في مجال التكنولوجيا ومتخصص في الشركات الناشئة، فإنني أتابع هذه المناقشات عن كثب، وأدرك أهمية التنظيم الذي يعزز الابتكار دون فرض حواجز مفرطة أمام التطور التكنولوجي.

ويهدف مشروع القانون المذكور إلى إرساء الأسس والمبادئ والتوجهات للذكاء الاصطناعي في الدولة. ورغم أن المبادرة تسعى إلى إنشاء إطار تنظيمي، فمن الأهمية بمكان تحليل كيفية تأثير أحكامها المحددة على منظومة الشركات الناشئة والابتكار التكنولوجي في البرازيل.

النقاط المحددة للمرسوم رقم 21/2020 وتأثيراته:

انضم إلى مجموعات WhatsApp الخاصة بي! تحديثات يومية بأهم أخبار الذكاء الاصطناعي و المجتمع النشط والمتنوع. *المجموعات باللغة الإنجليزية.*

- الذكاء الاصطناعي للأعمال: التركيز على الجانب التجاري والإستراتيجي.

- بناة الذكاء الاصطناعي: تركيز تقني وعملي.

- الأساسيات والمبادئ:

- ويضع القانون الأساسي مبادئ مثل التركيز على الإنسان، وعدم التمييز، والشفافية، والقدرة على التفسير. ورغم أهمية هذه المبادئ، فإن عدم الوضوح بشأن تطبيقاتها العملية قد يؤدي إلى خلق حالة من عدم اليقين لدى المطورين ورجال الأعمال.

- تعريفات واسعة لوكلاء الذكاء الاصطناعي:

- ويعرّف مشروع القانون "عملاء الذكاء الاصطناعي" بأنهم أولئك الذين يشاركون في تطوير وتشغيل أنظمة الذكاء الاصطناعي، دون تحديد مسؤوليات كل طرف بشكل واضح. يمكن أن يؤدي هذا التعميم إلى حالة من عدم اليقين القانوني، خاصة بالنسبة للشركات الناشئة التي تتعاون مع أطراف ثالثة في تطوير حلول الذكاء الاصطناعي.

- تعريف غير واضح لـ "المخاطر العالية":

- ويشير مشروع القانون إلى ضرورة اتخاذ تدابير حوكمة لأنظمة الذكاء الاصطناعي المصنفة على أنها "عالية الخطورة". ومع ذلك، فإنه لا يحدد بوضوح المعايير التي تحدد هذا التصنيف، مما يخلق حالة من عدم اليقين بالنسبة للمطورين ورجال الأعمال عند محاولة تحديد الالتزامات التنظيمية المطبقة على أنظمتهم.

- متطلبات تعيين البيانات والتدقيق:

- بالنسبة لأنظمة الذكاء الاصطناعي، وخاصة تلك عالية المخاطر، يقترح المشروع إجراء تحليلات الأثر ورسم خرائط المخاطر المرتبطة بالاستخدامات المتوقعة للنظام، فضلاً عن أشكال سوء الاستخدام المحتملة. علاوة على ذلك، يقترح حوكمة البيانات المستخدمة للتدريب والاختبار والتحقق من صحة النظام، بالإضافة إلى المراقبة المستمرة والتدقيق. قد تكون هذه المتطلبات غير قابلة للتطبيق بالنسبة للشركات الناشئة بسبب التكاليف والموارد اللازمة لتنفيذ عمليات الامتثال والتوثيق والتدقيق المعقدة. في بعض الحالات، واعتمادًا على بنية نموذج الذكاء الاصطناعي، قد يكون من المستحيل من الناحية الفنية رسم خريطة تفصيلية لجميع البيانات المستخدمة، خاصة عند استخدام نماذج التعلم العميق التي تعمل كـ "صناديق سوداء".

- تقرير تأثير الذكاء الاصطناعي (AIIR):

- على غرار تقرير تأثير حماية البيانات الشخصية الصادر عن LGPD، يقترح PL إجراء تقييم الأثر البيئي للذكاء الاصطناعي لتوثيق دورة حياة أنظمة الذكاء الاصطناعي وتدابير التخفيف من المخاطر. قد يكون إعداد هذا التقرير مكلفًا ومعقدًا بالنسبة للشركات الناشئة ذات الموارد المحدودة.

- العقوبات والجزاءات:

- وينص المشروع على عقوبات تتراوح بين التحذيرات والغرامات الكبيرة وتعليق الأنشطة المتعلقة بنظام الذكاء الاصطناعي في حالة عدم الامتثال. بالنسبة للشركات الناشئة، يمكن أن تكون هذه العقوبات غير متناسبة وتهدد قابلية استمرارية العمل.

- إشارة إلى اللوائح الإضافية:

- ويشير نص مشروع القانون إلى أنه لا يزال يتعين وضع لوائح إضافية لتفصيل جوانب معينة. إن الحاجة إلى اللوائح التنظيمية المستقبلية تخلق حالة من عدم اليقين بالنسبة للشركات الناشئة والمطورين، الذين قد يواجهون صعوبات في التخطيط وتطوير أنظمة الذكاء الاصطناعي الخاصة بهم دون إرشادات واضحة ومستقرة.

التأثيرات على الشركات الناشئة والابتكار:

إن الافتقار إلى الوضوح والتفصيل في النقاط الحاسمة في المرسوم PL 21/2020 قد يؤدي إلى بيئة تنظيمية غير مؤكدة، مما يثبط الشركات الناشئة والابتكارات في قطاع الذكاء الاصطناعي. قد تواجه الشركات الناشئة تحديات في تفسير المبادئ الغامضة والامتثال لها، فضلاً عن التعامل مع المسؤوليات القانونية التي قد تكون غير محددة بشكل جيد. ولكي يكون تنظيم الذكاء الاصطناعي في البرازيل فعالاً ويعزز الابتكار، فمن الضروري تحسين المشروع من خلال إرشادات واضحة وقابلة للتطبيق، يتم تطويرها بالحوار مع النظام البيئي التكنولوجي والمجتمع المدني.

✨تمت المراجعة بالكامل يمكنك التسجيل من خلال النشرات الصحفية من 10K Digital على بريدك الذكاء الاصطناعي الحديث.

منشورات ذات صلة

عرض الكل