Google Investe Pesado em IA Para Empresas Enquanto Deloitte Devolve R$ 1,5 Milhão Por Erros — Por Que Este Paradoxo Define o Momento da Maturidade Responsável

أكتوبر 10, 2025 | by Matos AI

As últimas 24 horas trouxeram um contraste fascinante no cenário da inteligência artificial no Brasil e no mundo. Enquanto o Google lança a Gemini Enterprise, uma plataforma robusta de IA para empresas com preços a partir de US$ 21 por usuário, a Deloitte precisou devolver US$ 440 mil ao governo australiano por erros graves em relatório gerado por IA.

Este paradoxo não é coincidência. Estamos vivendo o momento mais crítico da inteligência artificial: a transição da experimentação para a aplicação responsável e sustentável.

O Dia Que Definiu a Maturidade da IA

Ontem foi um daqueles dias que marcam época na história da tecnologia. Não pelos grandes anúncios — embora o Google tenha feito alguns importantes —, mas pela clareza com que ficou evidente onde estamos na jornada da inteligência artificial.

انضم إلى مجموعات WhatsApp الخاصة بي! تحديثات يومية بأهم أخبار الذكاء الاصطناعي و المجتمع النشط والمتنوع. *المجموعات باللغة الإنجليزية.*

- الذكاء الاصطناعي للأعمال: التركيز على الجانب التجاري والإستراتيجي.

- بناة الذكاء الاصطناعي: تركيز تقني وعملي.

De um lado, temos inovações impressionantes chegando ao mercado. O Gemini 2.5 Computer Use pode literalmente navegar na web por você, clicando, digitando e executando tarefas complexas. O Google AI Plus por R$ 24,99 democratiza o acesso a ferramentas de IA generativa avançadas.

Do outro lado, vemos os riscos se materializando de forma concreta: desde o golpe da oração que arrecadou R$ 3 milhões usando IA para gerar orações falsas, até grandes consultorias perdendo credibilidade por confiar demais em algoritmos.

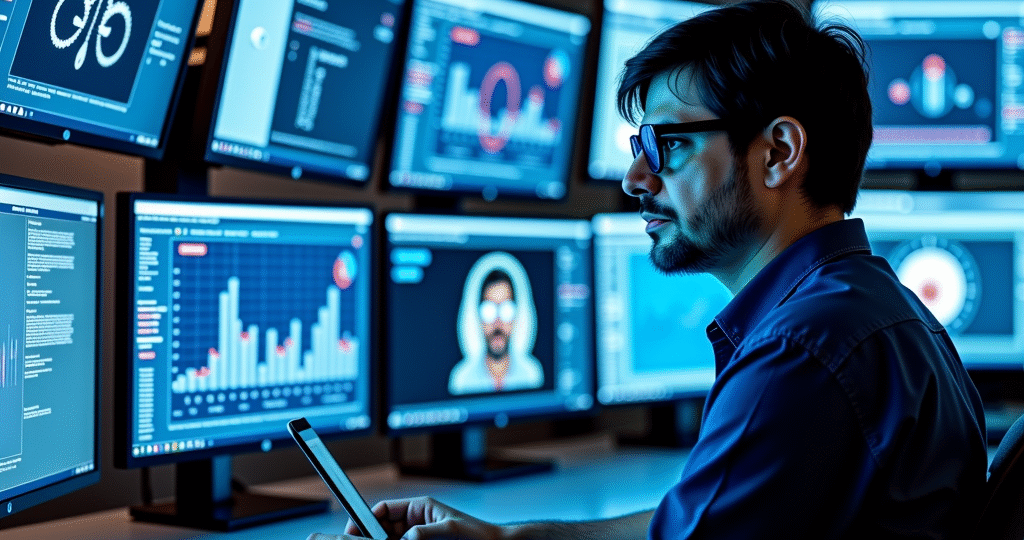

O Paradoxo da Adoção Acelerada

Os números revelam uma realidade intrigante. O uso de IA entre pesquisadores saltou de 57% para 84% em apenas um ano. Ao mesmo tempo, as preocupações com “alucinações” e imprecisões cresceram de 51% para 64%.

Este não é um paradoxo, é maturidade.

Em minha experiência apoiando o desenvolvimento de ecossistemas de inovação, sempre observei que as tecnologias mais transformadoras passam por esta fase: uso crescente acompanhado de consciência crescente sobre limitações.

A diferença agora é a velocidade. Estamos comprimindo ciclos que normalmente levariam décadas em anos ou até meses.

Lições do Fracasso da Deloitte

O caso da Deloitte é um marco. Uma das maiores consultorias globais teve que devolver US$ 440 mil por produzir um relatório oficial com informações inventadas pela IA. Mesmo após revisão humana, os erros persistiram.

Isto não é sobre falha tecnológica. É sobre processo.

A IA não falhou — ela fez exatamente o que foi programada para fazer: gerar texto que parece plausível. O que falhou foi a supervisão humana, a validação crítica, os checkpoints de qualidade.

Em meu trabalho com empresas, sempre enfatizo: IA não é sobre substituir humanos, é sobre amplificar capacidades humanas. Quando tentamos pular esta etapa, pagamos o preço — literalmente, no caso da Deloitte.

Os Três Pilares do Uso Responsável

A partir do que observo nas organizações que trabalho, identifiquei três pilares fundamentais para uso responsável da IA:

- Transparência: Sempre declarar quando e como IA foi utilizada

- Validação: Estabelecer checkpoints humanos obrigatórios

- Responsabilidade: Manter accountability humana sobre resultados finais

O Brasil na Vanguarda da Educação em IA

Enquanto vemos casos negativos internacionais, o Brasil está dando passos consistentes na direção certa. O MEC abriu consulta pública sobre uso ético de IA na educação, e a CAPES expandiu para 40 mil vagas seu curso gratuito sobre IA para educadores.

Esta abordagem — consulta ampla à sociedade antes de implementar — é exatamente o que diferencia adoção responsável de experimentação arriscada.

O foco em educação é estratégico. Não adianta termos ferramentas poderosas se não tivermos pessoas preparadas para usá-las de forma crítica e responsável.

A Democratização Real Acontecendo

O lançamento do Google AI Plus por R$ 24,99 mensais marca um momento histórico: IA avançada ao alcance de qualquer profissional brasileiro. Incluindo 200GB de armazenamento e integração com ferramentas do dia a dia, é um preço que democratiza acesso.

Mas democratização vem com responsabilidade. Candidatos já estão tentando enganar sistemas de IA em recrutamento, criando uma corrida armamentista entre algoritmos e pessoas tentando burlá-los.

Este fenômeno me lembra dos primeiros dias da internet, quando spam e técnicas de SEO maliciosas proliferaram. A solução não foi menos tecnologia, foi mais educação e melhores práticas.

O Momento do Teste de Turing

Não é coincidência que o Teste de Turing voltou ao debate exatamente agora. O ChatGPT-4.5 já consegue enganar humanos em 73% das interações, mas isso importa menos do que pensávamos.

O verdadeiro teste não é se a IA consegue nos enganar — é se conseguimos usá-la de forma que agregue valor genuíno sem substituir o julgamento humano onde ele é essencial.

Três Tendências que Definem o Futuro

Com base no que observei nas últimas 24 horas, vejo três tendências claras emergindo:

1. Regulação Proativa

O MEC saindo na frente com consulta pública mostra que o Brasil está aprendendo com erros alheios. Não esperamos problemas para depois regular — estamos estabelecendo diretrizes antes da adoção em massa.

2. IA Como Ferramenta, Não Oráculo

O caso Deloitte vai virar case de estudo. Empresas sérias estão percebendo que IA funciona melhor como assistente especializado do que como substituto do raciocínio crítico.

3. Democratização com Educação

Preços acessíveis combinados com programas massivos de capacitação indicam que estamos priorizando adoção responsável sobre adoção rápida.

لماذا هذه اللحظة تاريخية

Estamos vivendo a primeira geração de uma tecnologia que nos força a redefinir nossa relação com informação, criatividade e trabalho em tempo real.

Diferente de revoluções anteriores — internet, mobile, redes sociais — a IA questiona não apenas como fazemos as coisas, mas como validamos se elas estão corretas.

O golpe da oração usando IA para enganar pessoas vulneráveis é apenas a ponta do iceberg. Quando algoritmos podem gerar conteúdo indistinguível do humano, nossa relação com verdade e confiança muda fundamentalmente.

Mas isto não é motivo para desespero — é convite à responsabilidade.

O Que Fazer Agora

Se você é líder, gestor ou empreendedor, três ações concretas emergem deste momento:

Primeiro: Estabeleça políticas claras de uso de IA em sua organização. Não pode ser “vale tudo” nem “proibido tudo”. Precisa ser “como usar bem”.

Segundo: Invista em educação antes de investir em ferramenta. Uma equipe preparada com ferramentas simples entrega mais valor que uma equipe despreparada com ferramentas sofisticadas.

Terceiro: Participe do debate público. A consulta do MEC é apenas o começo. Empresas e profissionais precisam compartilhar aprendizados para construirmos melhores práticas coletivamente.

O Futuro Está Sendo Escrito Agora

Nos próximos 12 meses, as decisões que tomarmos sobre como usar IA vão definir se ela se torna aliada ou problema para nossa sociedade.

A tecnologia está pronta. As ferramentas estão disponíveis. Os preços estão acessíveis.

O que falta é sabedoria coletiva para usá-las bem.

Em meu mentoring executivo e nos cursos imersivos que desenvolvo, tenho observado uma fome genuína por orientação prática sobre IA. Não apenas “como usar”, mas “como usar bem, como usar responsavelmente, como usar de forma que gere valor real”.

Porque no final das contas, o futuro da inteligência artificial não será determinado pelos algoritmos — será determinado pela inteligência humana que os guia.

E esse futuro está sendo escrito nas decisões que tomamos hoje.

✨تمت المراجعة بالكامل يمكنك التسجيل من خلال النشرات الصحفية من 10K Digital على بريدك الذكاء الاصطناعي الحديث.

منشورات ذات صلة

عرض الكل